最近接手了一个特别头疼的老项目,那代码真的是古董级别的。当时写代码的人,用C++写业务逻辑的时候,完全没考虑过跨平台或者国际化这种高大上的东西。他们的环境是Windows,编码直接就是最原始的GBK,也就是大家常说的“内码”。

痛苦的开始:乱码像瘟疫一样传播

现在我们要把这个老服务部署到Linux服务器上,并且要和我们新的UTF-8标准接口对接。老代码一搬上去,控制台输出和日志文件直接就炸了。全屏幕的问号、黑块,简直就是乱码的海洋。

我当时的第一反应是:不就是转个码嘛我直接用`std::string`读出来,然后暴力转一下不就行了?

我天真了。我尝试用C++自带的那些Locale相关的函数去处理,结果发现效果非常差。在Windows上能跑,但转出来的数据总感觉长度不对。丢到Linux上,Locale设置又是个大麻烦,经常因为环境差异导致程序崩溃或者转换失败。

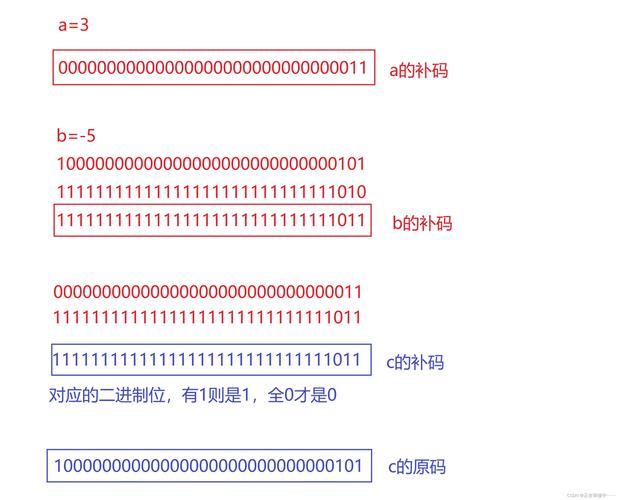

我折腾了整整一天,试图用一些通用的C++库来解决,但每次都遇到同一个问题:GBK里一个汉字占两个字节,UTF-8里可能占三个字节,如果数据流里混了特殊符号或者半个汉字,库就懵了,结果就是转换出来的数据是错的。

彻底认清现实:求助操作系统

实践证明,在C++里面硬刚编码转换,尤其涉及到老旧的GBK和现代的UTF-8之间的互转,效率最低。最好的办法就是交给操作系统去处理,因为它们有专门优化过的API来干这个活。

我决定兵分两路,分别实现Windows和Linux下的内码转换逻辑,然后用一个统一的C++接口把它包起来,这样上层业务调用的时候就感觉不到底层差异了。

Windows实践记录:老老实实调用API

在Windows下,主要就是靠那两个核心的API函数。逻辑很简单,但过程非常考验耐心:

- 第一步:从GBK转成宽字符(UTF-16)。 我需要先喂给它GBK的字节流,然后调用API,但不是直接转换,而是先传个0作为输出缓冲区大小,让它告诉我,“你这个字符串转成宽字符后,需要多少个`wchar_t`的空间?”

- 第二步:分配空间并转换。 拿到需要的空间大小后,我用`new`或者`std::vector`分配足够的内存,然后把GBK数据和分配好的内存块都传进去,API就能稳稳地把窄字节流转成宽字节流。

- 第三步:从宽字符转回UTF-8。 因为我们的目标是UTF-8,所以还得再来一次。把刚才转换好的宽字符流作为输入,重复第一步的操作,算出它转成UTF-8窄字节需要多大的缓冲区。

- 第四步:最终输出。 分配好UTF-8的缓冲区,再次调用API,最终拿到干净、正确的UTF-8字符串。

这一套流程走下来,虽然调用了四次系统函数,但因为是操作系统底层优化的,转换速度非常快,而且彻底解决了GBK数据带到UTF-8环境下的乱码问题。

Linux实践记录:转战另一套工具

当我把这套代码拿到Linux上的时候,发现编译都通不过因为Windows的API根本不存在。

在Linux的世界里,内码转换主要靠的是另一套机制,虽然接口名字和Windows完全不一样,但干的活儿是一模一样的,甚至思路都一样:先打开一个转换器,告诉它我要从“GBK”转到“UTF-8”,然后循环调用它的转换函数,把输入数据一块一块喂进去,然后从输出缓存里拿结果。

我发现Linux这套工具链有个好处,就是它能直接从GBK转到UTF-8,不需要像Windows那样中间非得经过UTF-16过渡一下。这让我的代码稍微简洁了一点点。

实践不要自己去管字节流

这回内码转换的实践让我明白了一个道理:C++虽然强大,但是遇到编码这种历史遗留问题,尤其是跨平台、跨时代的,不要试图用通用的C++字符串函数去解决。那些API函数就是专门为这种痛苦的内码转换而生的。

我用了一个宏定义,在头文件里判断如果是Windows环境,就包含Windows的头文件,如果是Linux,就包含Linux的头文件。然后我写了两个同名的静态函数,一个包裹Windows API,一个包裹Linux的工具函数,上层业务调用的永远是同一个函数名,这样就彻底解决了历史遗留编码的困扰。

现在回想起来,最麻烦的不是调用函数本身,而是精确计算缓冲区大小。只要缓冲区算错了,不管是Windows还是Linux,都会导致内存越界访问或者数据截断。这是这回实践里最值得记录下来的血泪教训!

以后再遇到这种老项目,我肯定第一时间就绕开那些花哨的字符串库,直奔系统底层API,那才是解决内码问题的硬核办法。